Roma – 10 giugno 2025

Translated, leader nelle soluzioni linguistiche basate sull'intelligenza artificiale, annuncia oggi un importante traguardo per Lara, il suo modello di IA per la traduzione. Un successo reso possibile dalla sinergica collaborazione con Lenovo, leader globale nel settore del calcolo ad alte prestazioni. Progettata per ambienti produttivi ad alto volume, Lara offre oggi quello che prima richiedeva un compromesso: unire la fluidità e le capacità di ragionamento di un grande modello linguistico (large language model, LLM) alla precisione e affidabilità della traduzione automatica, garantendo prestazioni in tempo quasi istantaneo.

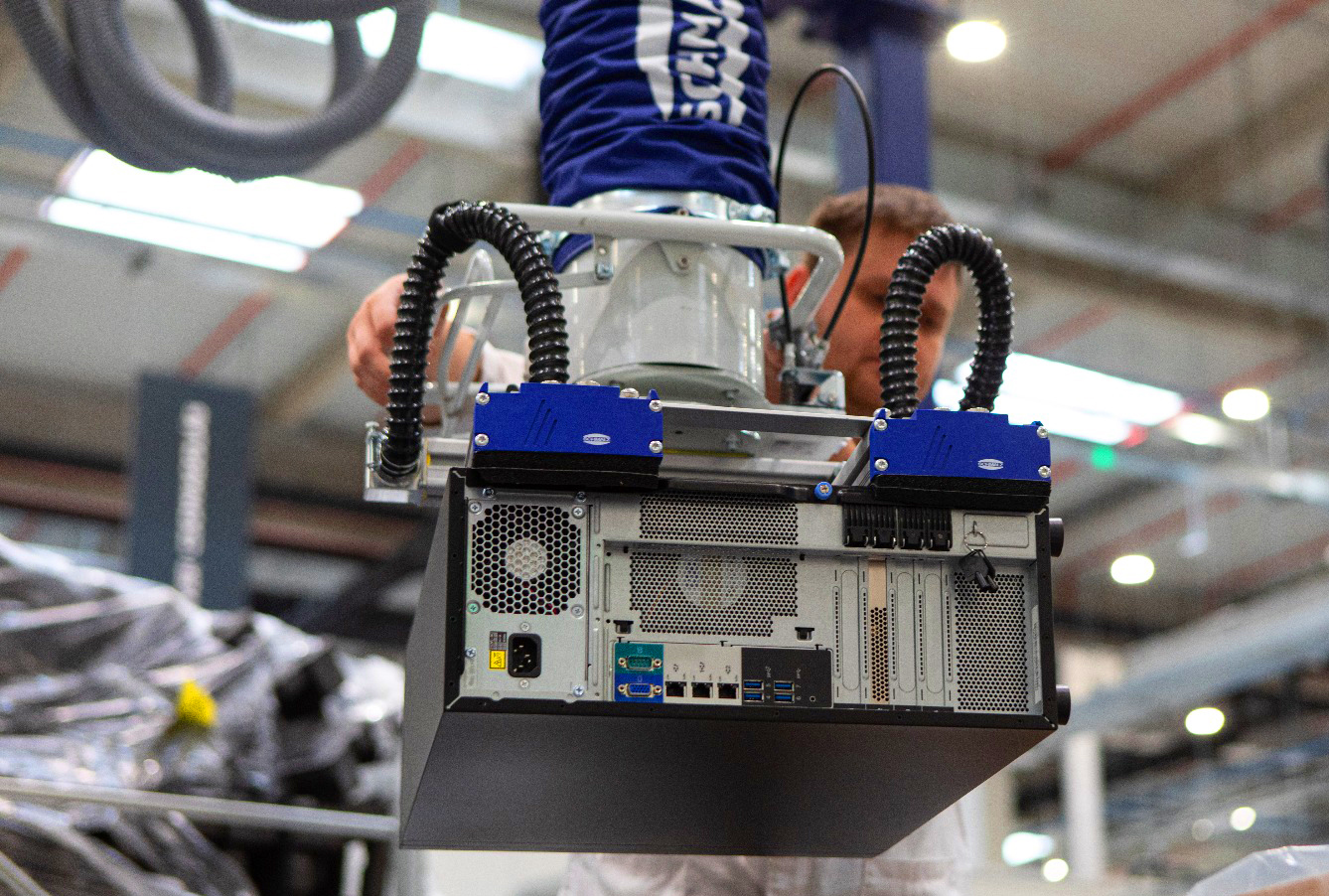

Per raggiungere questo risultato, Translated ha co-progettando insieme a Lenovo una soluzione hardware dedicata alla traduzione e sviluppando un sistema di decodifica innovativo per sfruttare al massimo le prestazioni dei processori di ultima generazione. Ottimizzata per contesti critici in termini di latenza, come chat in tempo reale, trading e notizie, Lara oggi raggiunge una latenza P99 inferiore al secondo nelle 50 lingue più parlate al mondo. È un’innovazione che fissa un nuovo standard per traduzioni di alta qualità e bassa latenza, aprendo la strada a soluzioni economicamente più efficienti, come la traduzione immediata della sola parte di contenuto necessaria, elaborando il resto solo su richiesta. Nella traduzione, Lara è ora da 10 a 40 volte più veloce dei principali modelli linguistici (LLM), offrendo allo stesso tempo una qualità superiore che la rende perfetta per i moderni flussi di lavoro aziendali.

Per raggiungere queste prestazioni, Lenovo ha fornito i server ThinkSystem basati sulle GPU di NVIDIA, i processori più avanzati al mondo per i carichi di lavoro dell'IA. Ogni server supporta otto delle più recenti GPU interconnesse e ad alta velocità, che alimentano i progressi dell'IA, tra cui i large language model, il machine learning, il training dei modelli e il computing ad alte prestazioni. Grazie a un intenso lavoro di progettazione congiunta, Translated e Lenovo sono riuscite a ottimizzare l'architettura per la traduzione. I server ThinkSystem sono stati installati in due data center a Washington e in California, strategicamente posizionati vicino ai principali hub internet per mantenere la latenza della rete tra Lara e le principali dorsali di rete sotto al millisecondo.