Wir stellen vor: Lara

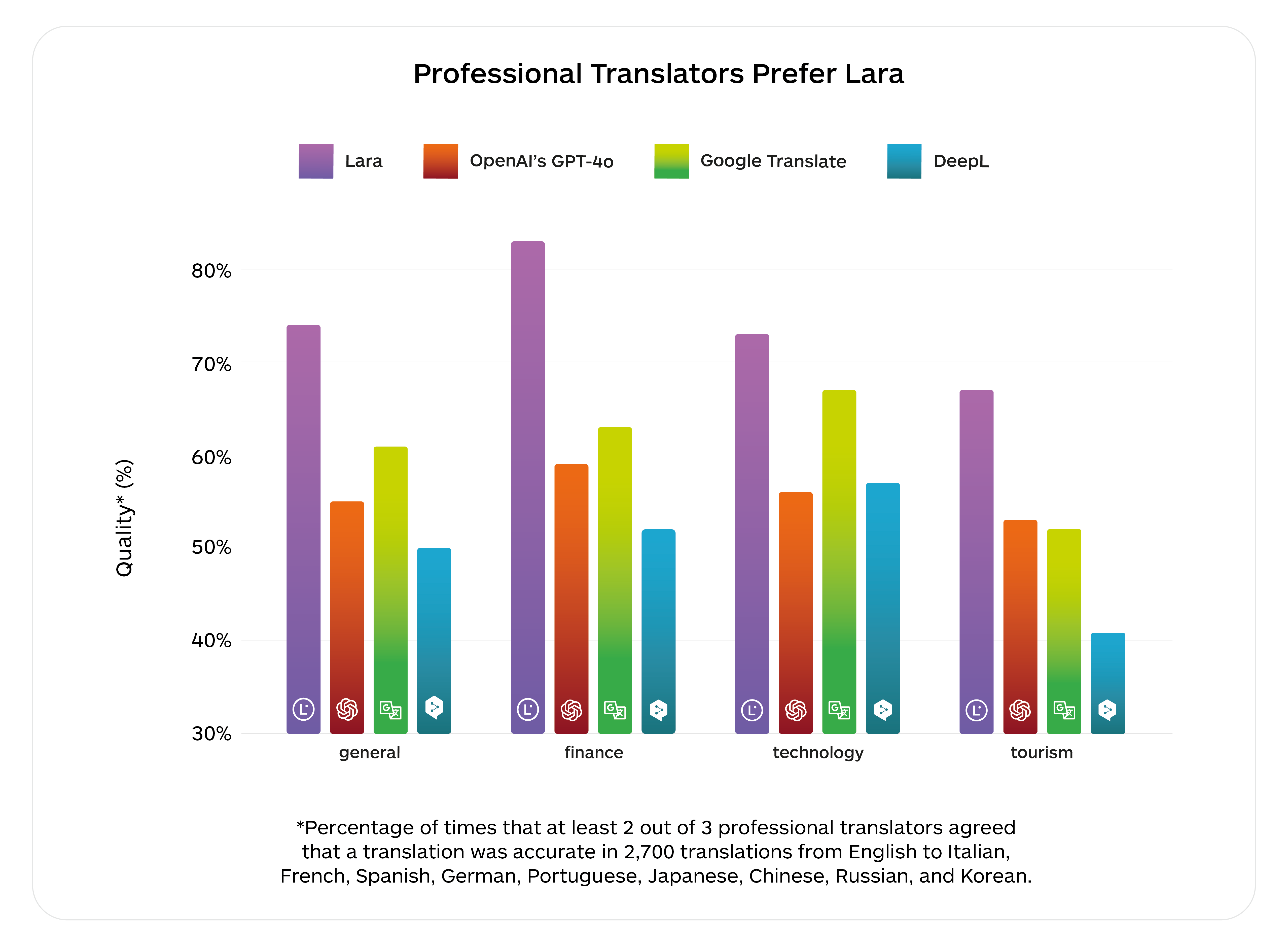

Unser CEO Marco Trombetti hat Lara vorgestellt, den Höhepunkt von über 15 Jahren Forschung im Bereich der maschinellen Übersetzung. Im Jahr 2011 waren wir Pioniere der adaptiven MT. Seit 2017 betreiben wir unser neuronales MT-System mit dem Transformer-Modell, das ursprünglich für Übersetzungen entwickelt wurde und später zur Grundlage der generativen KI wurde. Als große Sprachmodelle nach der Veröffentlichung von ChatGPT an Popularität gewannen, waren viele beeindruckt von ihrer Sprachgewandtheit und der Fähigkeit, große Kontexte zu verarbeiten. Gleichzeitig waren sie jedoch auch frustriert über die mangelnde Genauigkeit dieser Modelle. Wir arbeiteten bereits unermüdlich daran, die Leistungsfähigkeit großer Sprachmodelle mit der Genauigkeit der maschinellen Übersetzung zu kombinieren. Heute sind wir stolz darauf, diesen Meilenstein erreicht zu haben, indem wir beide mit Lara, der weltweit besten Übersetzungs-KI, kombiniert haben.

Lara definiert die maschinelle Übersetzung neu, indem sie ihre Entscheidungen erläutert und kontextuelles Verständnis sowie logische Argumentation nutzt, um professionelle Übersetzungen zu liefern, denen die Nutzer vertrauen können. Sie wurde mit dem größten und sorgfältigst kuratierten Datensatz realer Übersetzungen trainiert, der weltweit verfügbar ist. Dank unserer langfristigen Zusammenarbeit mit NVIDIA wurde Lara auf der NVIDIA-KI-Plattform mit 1,2 Millionen GPU-Stunden geschult.

Mit Lara können Unternehmen bisher unvorstellbare Lokalisierungsprojekte angehen. Übersetzer und mehrsprachige Kreative werden Lara bei ihrer täglichen Arbeit zu schätzen wissen und ein neues Maß an Produktivität und Genauigkeit erreichen.

Laras Fehlerquote liegt bei lediglich 2,4 pro tausend Wörter. Im Jahr 2025 wollen wir noch höher hinaus: Wir planen 20 Millionen GPU-Stunden zu nutzen, um der Sprachsingularität weiter näherzukommen.