Vi presenterar Lara

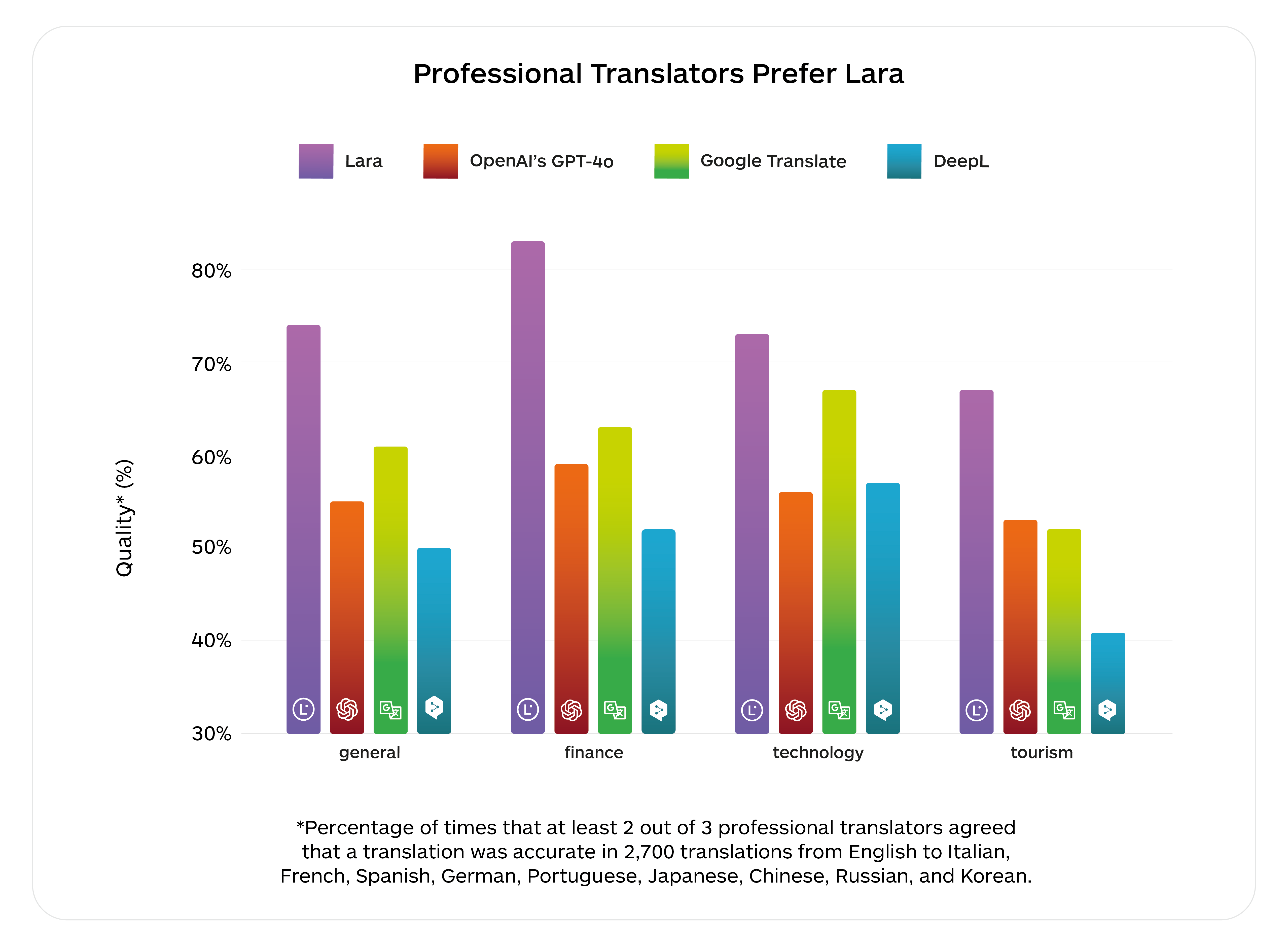

Vår VD Marco Trombetti introducerade Lara, resultatet av över 15 års forskning inom maskinöversättning. Under 2011 banade vi väg för adaptiv MT. Sedan 2017 har vi drivit vårt neurala MT-system med Transformer-modellen, som uppfanns för att underlätta översättning och som senare blev grundläggande för generativ AI. När stora språkmodeller blev populära efter lanseringen av ChatGPT blev många förvånade över deras flyt och förmåga att hantera större sammanhang – men blev även frustrerade över deras brist på noggrannhet. Vi jobbade redan då outtröttligt för att kombinera kraften i stora språkmodeller med hjälp av noggrannheten i maskinöversättning. Idag är vi stolta över att ha nått denna milstolpe genom att kombinera båda med Lara, världens bästa AI för översättning.

Lara omdefinierar maskinöversättningen genom att förklara sina val, utnyttja kontextuell förståelse och resonemang för att leverera professionella översättningar som användare kan lita på. Den är utbildad i den största, mest kurerade datauppsättningen av verkliga översättningar som globalt finns tillgängliga. Lara utbildades på AI-plattformen NVIDIA med hjälp av 1,2 miljoner GPU-timmar, tack vare vårt långsiktiga samarbete med NVIDIA.

Med Lara kan företag hantera tidigare otänkbara lokaliseringsprojekt. Översättare och flerspråkiga kreatörer kommer att älska att ha Lara med sig i sina dagliga arbeten och uppnå nya nivåer av produktivitet och noggrannhet.

Laras felprocent är endast 2,4 per tusen ord. År 2025 siktar vi ännu högre. Vi planerar att utnyttja 20 miljoner GPU-timmar för att ytterligare närma oss språksingularitet.