Esittelyssä Lara

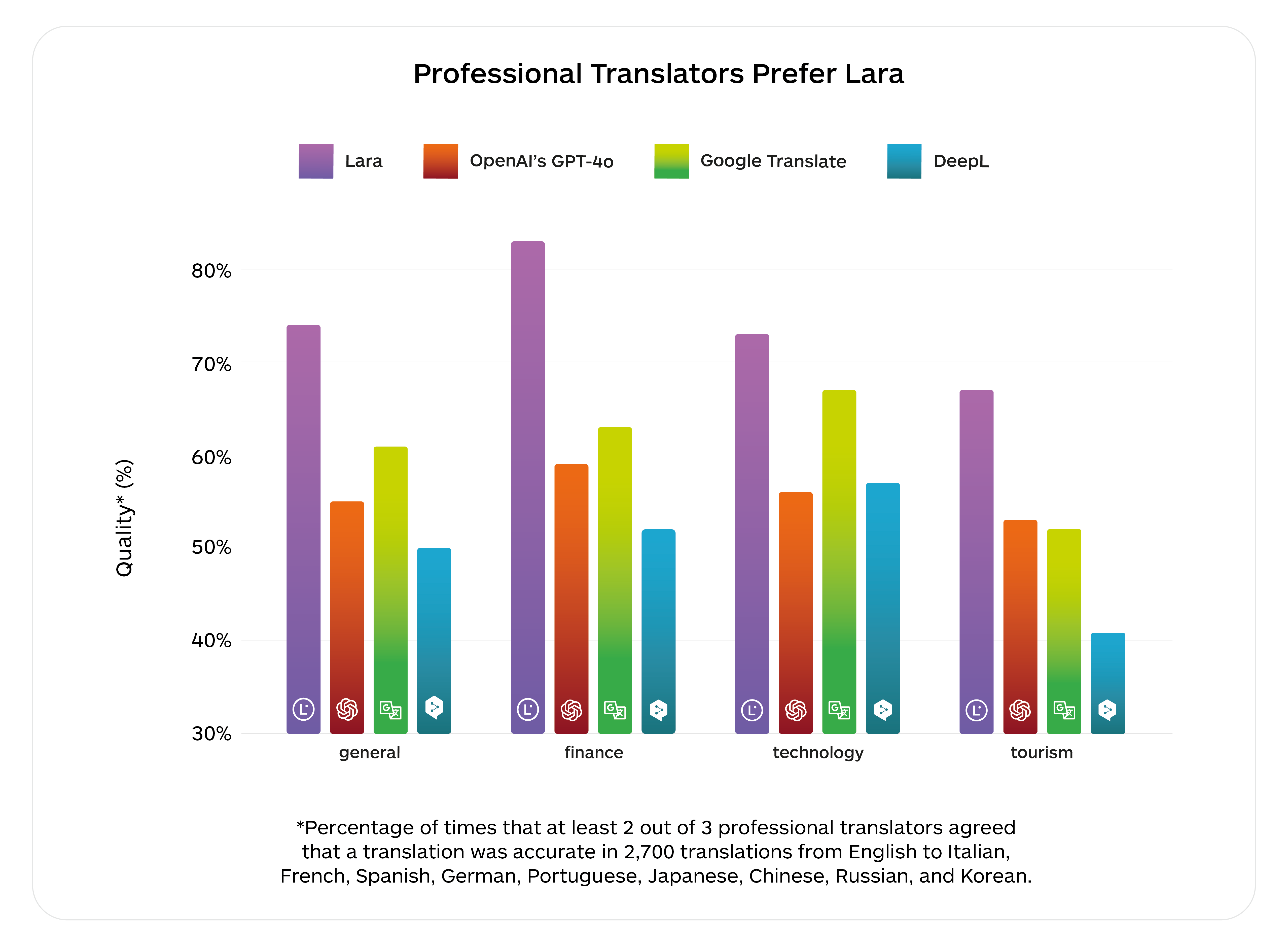

Toimitusjohtajamme Marco Trombetti esitteli Laran, joka on yli 15 vuoden konekäännöstutkimuksen huipentuma. Vuonna 2011 olimme edelläkävijöitä mukautuvassa konekäännöksessä. Vuodesta 2017 lähtien olemme käyttäneet neuroverkkoihin perustuvaa konekäännösjärjestelmäämme Transformer-mallin kanssa, joka keksittiin kääntämistä varten ja josta tuli myöhemmin perusta generatiiviselle tekoälylle. Kun suuret kielimallit saivat suosiota ChatGPT:n julkaisun jälkeen, monet hämmästelivät niiden sujuvuutta ja kykyä käsitellä laajoja asiayhteyksiä, mutta samalla he olivat turhautuneita niiden tarkkuuden puutteesta. Teimme jo silloin kovasti töitä yhdistääksemme suurten kielimallien voiman konekääntämisen tarkkuuteen. Nyt olemme ylpeitä siitä, että olemme saavuttaneet tämän virstanpylvään yhdistämällä molemmat Laraan, maailman parhaaseen käännöstekoälyyn.

Lara määrittelee konekäännöksen uudelleen selittämällä valintansa, hyödyntämällä kontekstuaalista ymmärrystä ja päättelyä tuottaakseen ammattimaisia käännöksiä, joihin käyttäjät voivat luottaa. Se on koulutettu suurimman, kuratoiduimman reaalimaailman käännösten tietoaineiston pohjalta, joka on maailmanlaajuisesti saatavilla. Lara koulutettiin NVIDIA AI -alustalla käyttämällä 1,2 miljoonaa GPU-tuntia pitkäaikaisen NVIDIA-yhteistyömme ansiosta.

Laran avulla yritykset voivat tarttua lokalisointiprojekteihin, joita ei aiemmin voitu ajatellakaan. Kääntäjät ja monikieliset tekijät nauttivat Larasta päivittäisessä työssään ja saavuttavat uuden tuottavuuden ja tarkkuuden tason.

Laran virhekeskiarvo on vain 2,4/1 000 sanaa. Vuonna 2025 pyrimme vielä parempaan: aiomme käyttää 20 miljoonaa GPU-tuntia päästäksemme vielä tarkempaan lopputulokseen.