Vi presenterer Lara

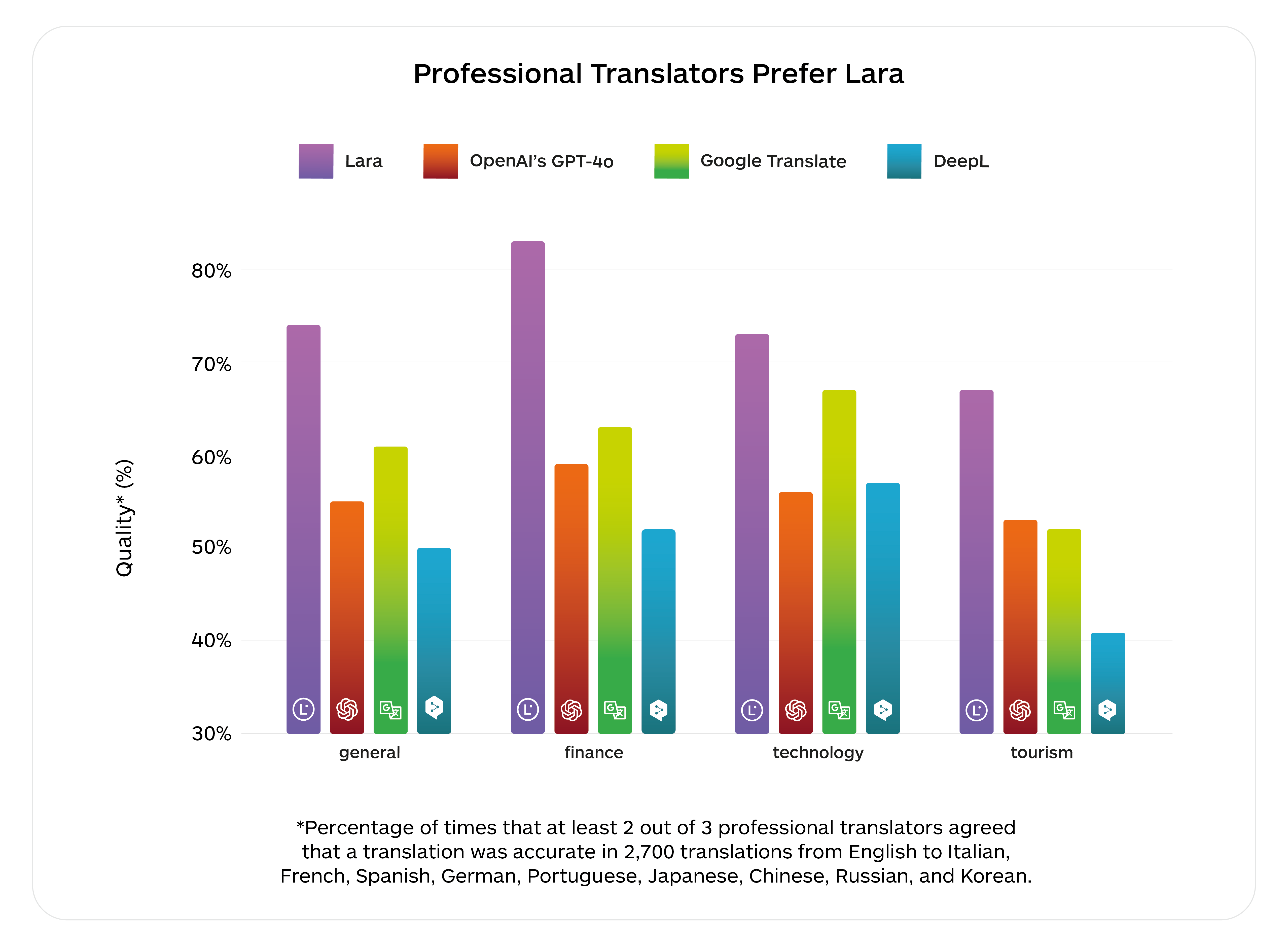

Vår administrerende direktør, Marco Trombetti, introduserte Lara, resultatet av over 15 års forskning på maskinoversettelse. I 2011 var vi pionerer innen adaptiv MT. Siden 2017 har vi drevet vårt nevrale MT-system med Transformer-modellen, som opprinnelig var ment til oversettelse og senere ble grunnleggende for generativ KI. Da store språkmodeller ble populære etter utgivelsen av ChatGPT, ble mange overrasket over flyten og evnen de hadde til å håndtere komplekse sammenhenger, men også frustrert over mangelen på nøyaktighet. Vi jobbet allerede utrettelig med å kombinere styrken i store språkmodeller med nøyaktigheten i maskinoversettelse. I dag er vi stolte over å ha nådd en milepæl – ved å kombinere begge deler med Lara, verdens beste oversettelses-KI.

Lara omdefinerer maskinoversettelse ved å forklare sine valg samt utnytte kontekstuell forståelse og resonnement for å levere profesjonelle oversettelser brukerne kan stole på. Den er opplært i det største, mest kuraterte datasettet som finnes av oversettelser fra den virkelige verden. Lara ble opplært på NVIDIA-KI-plattformen ved hjelp av 1,2 millioner GPU-timer, takket være vårt langsiktige samarbeid med NVIDIA.

Med Lara kan bedrifter takle lokaliseringsprosjekter som tidligere var utenkelige. Oversettere og flerspråklige innholdsskapere vil kunne glede seg over Lara i sitt daglige arbeid, og oppnå enda bedre produktivitet og nøyaktighet.

Laras feilprosent er bare 2,4 per tusen ord. I 2025 tar sikter vi enda høyere, gjennom å planlegge for å utnytte 20 millioner GPU-timer for å nærme oss språksingularitet ytterligere.